企业级私有化大模型与深度学习集群建设

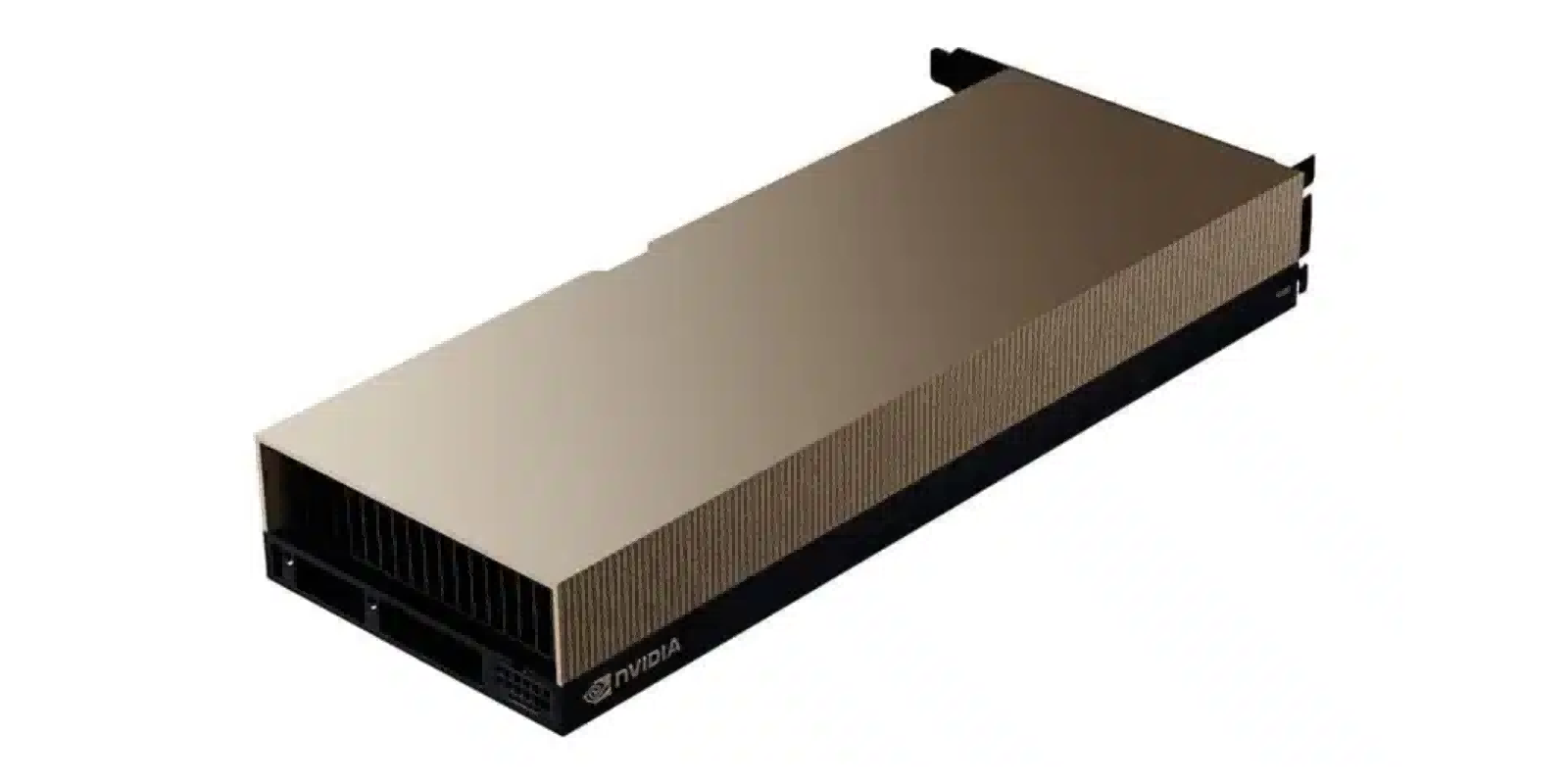

作为 AI 时代最经典、生态最完美的算力底座,A100-SXM 是企业从零构建私有化大语言模型(LLM)训练集群的稳健之选。凭借 80GB 大显存和全互联的 SXM 架构,完美支撑百亿至千亿参数大模型的分布式预训练与全量微调,确保企业的核心商业数据与模型资产在本地环境中的绝对安全与高度可控。

超大规模计算机视觉与多模态模型研发

对于自动驾驶、医疗影像分析和复杂的生成式 AI(AIGC)研发团队,A100 的强大张量核心与极高的内存带宽能提供稳定且高效的持续训练能力。SXM 架构带来的无损卡间通信,使得在处理超大分辨率图像批次或长视频序列流时,能够将多卡的线性加速比发挥到极致。

国家级超算中心与前沿科学计算 (HPC)

除了强大的 AI 混合精度算力,A100 具备业界顶级的双精度(FP64)计算能力。是高校、科研院所以及能源、制药企业采购构建超级计算机的标配。在分子动力学模拟、基因组学测序、高能物理与气象预测等极其依赖双精度算力的应用中,提供无可替代的性能底座。

高可用性的 AI 生产环境与高并发推理调度

适用于需要构建统一内部 AI 算力中台的大型机构。通过多实例 GPU(MIG)技术,可以将单张 A100 硬件级划分为最多 7 个独立实例,灵活分配给不同部门的开发、测试与并发推理任务,极大提升整机硬件的采购投资回报率(ROI)。