企业级 AI 创作与开源大模型部署

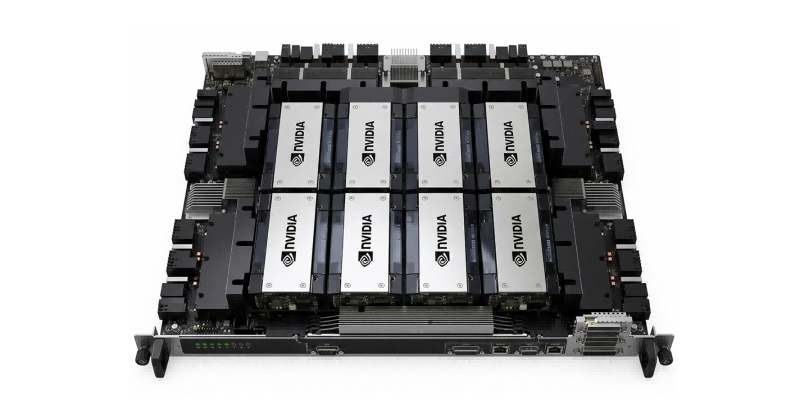

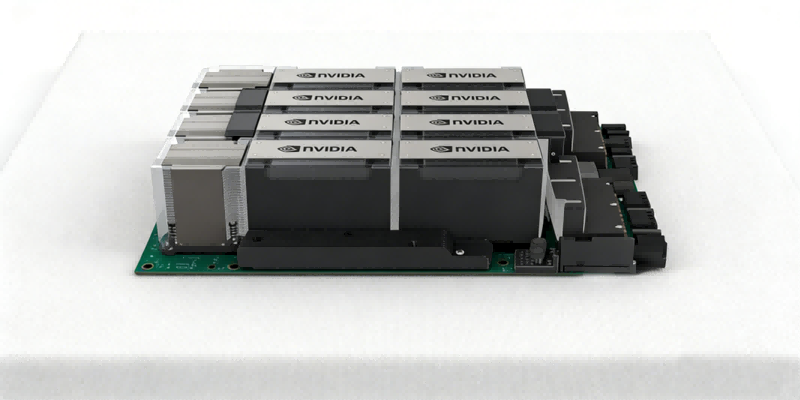

凭借高达 141GB HBM3e 的海量显存和 4.8 TB/s 的极致带宽,这是目前算力中心最强大的 AI 生产力核心。完美胜任极度吃显存的开源 AI 视频生成模型的集群部署与大规模微调;在云端并行运行极度复杂的 ComfyUI 节点工作流或进行千亿参数大语言模型(LLM)推理时,能够彻底打破显存溢出(OOM)的枷锁,实现吞吐量的断层式领先。

超大规模深度学习与前沿模型训练

专为拒绝算力妥协的顶级 AI 实验室与科技巨头打造。在千亿甚至万亿参数模型(如大语言模型或 Sora 级别的视频生成架构)的训练中,141GB 显存允许将更庞大的模型参数与超长上下文完整驻留在单卡或极少卡中,大幅减少并行切片带来的通信开销,带来立竿见影的训练周期缩短。

大并发云端推理与 MLaaS 平台部署

适用于需要强大并发吞吐能力的云服务商和算法企业,结合底层 NVLink 互联技术,在多用户高频请求下依然能保持极低延迟。相比上一代产品,在提供大规模生成式 AI 服务时,能够实现近乎翻倍的推理速度与减半的能耗,是构建顶级云端算力底座的终极选择。

高性能计算与复杂前沿科学模拟

为需要极致内存带宽的科研人员提供媲美超级计算机的算力支持。在气候模拟、基因组学、高频量化交易分析等内存密集型计算领域,HBM3e 带来的超高带宽让数据传输不再是瓶颈,提供远超传统架构的效率飞跃。