高性价比大模型推理与本地微调部署

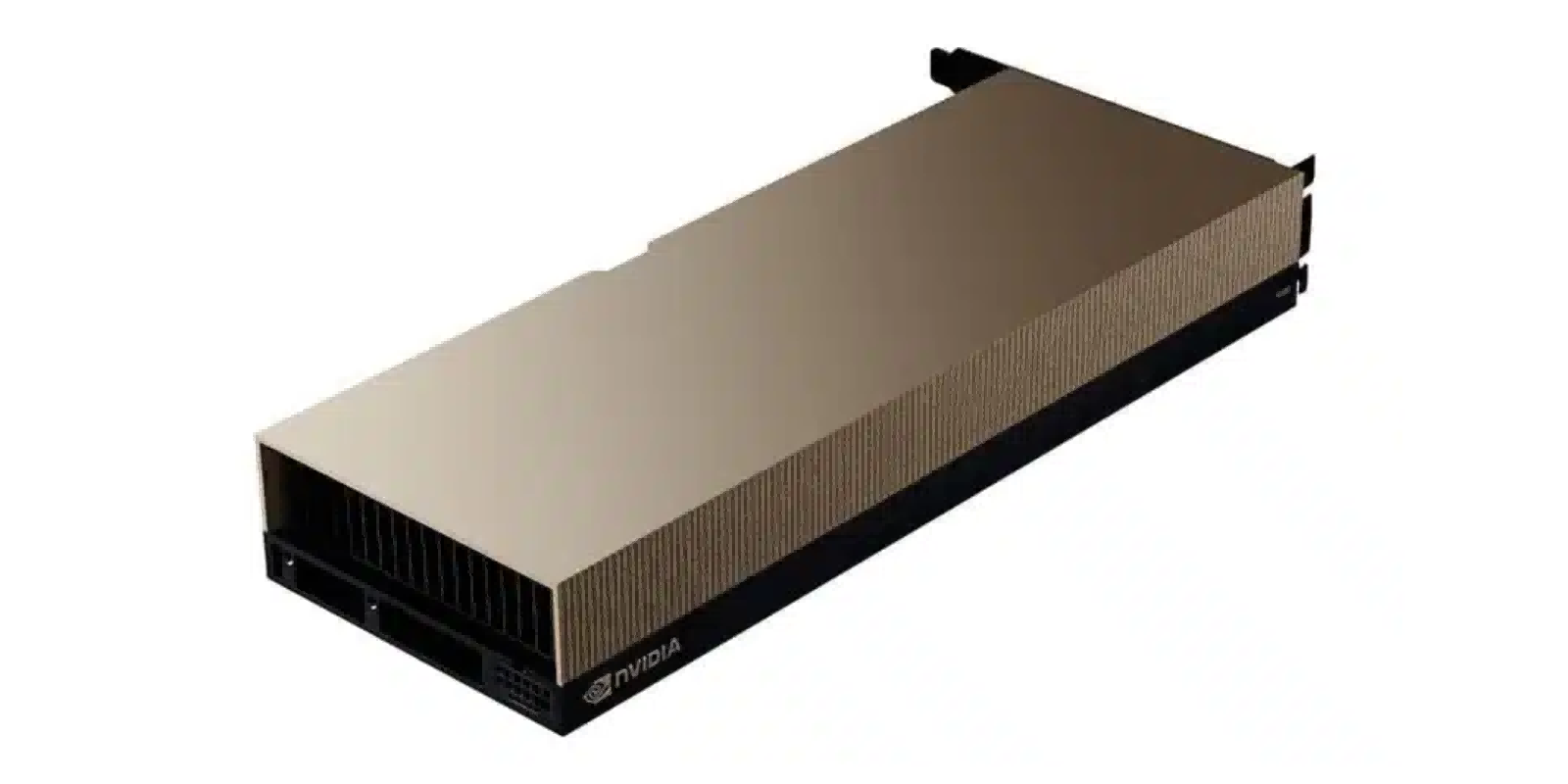

作为 AI 时代应用最广泛的经典算力核心,A100 PCIE 凭借 80GB HBM2e 大显存,是企业在本地部署百亿至千亿参数大语言模型(LLM)的稳健之选。非常适合进行 Llama 3、Qwen 等开源模型的 LoRA 微调与高并发推理服务,能够在合理的采购预算下,为企业搭建安全、私密且高效的 AI 生产力底座。

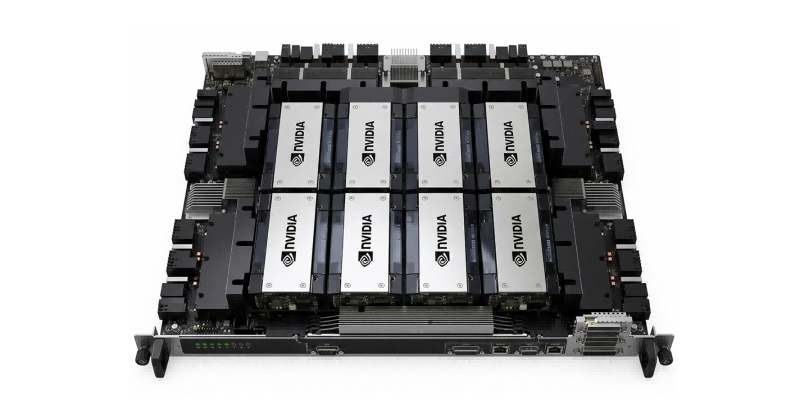

企业级 AI 算力中台与虚拟化分配

对于需要为多个研发团队或高校实验室提供统一算力支持的机构,A100 PCIE 是极为理想的硬件资产。依托其原生的多实例 GPU(MIG)技术,管理员可将单张显卡在硬件层面上安全隔离为最多 7 个独立的算力实例,按需分配给不同的开发、测试或轻量级推理任务,极大提升硬件投资回报率(ROI)。

前沿科学计算 (HPC) 与海量数据分析

不仅在 AI 领域表现卓越,A100 同样是超级计算的标杆。其具备业界顶尖的双精度(FP64)计算能力,在极其依赖双精度算力的分子动力学模拟、基因测序、气象预测和高频量化金融交易等领域,提供无可替代的底层数据处理引擎。

高吞吐量计算机视觉与多模态生成

在传统的计算机视觉(CV)模型训练以及当前的生成式 AI(如 Stable Diffusion 商业出图、基础视频生成)中,高达 1,935 GB/s 的显存带宽确保了在处理超大分辨率图像批次时,显存传输不再是系统瓶颈,极大加速模型收敛与云端渲染速度。