万亿级参数大模型(GPT-5级别)私有化训练基建

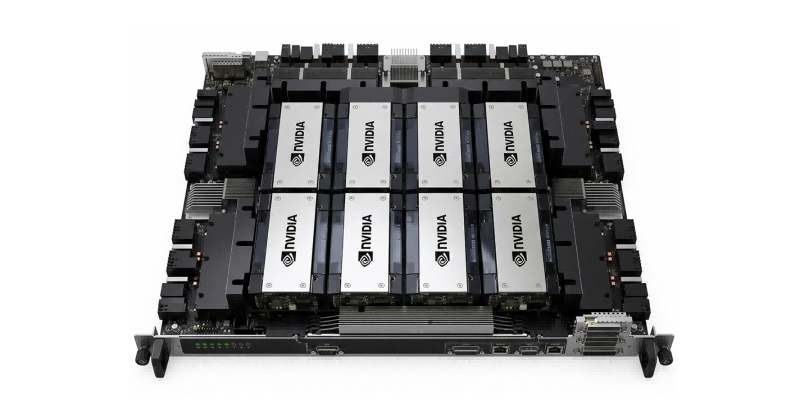

凭借 8 卡高达 1.5TB 的 HBM3e 巨量总显存和 Blackwell 架构的恐怖算力,B200 整机是企业与算力中心跨入“万亿参数时代”的终极入场券。原生支持的 FP4 精度计算与第二代 Transformer 引擎,能够在同等模型质量下将有效训练吞吐量提升至上一代(H100)的数倍。它是头部科技巨头从零预训练超大规模稠密模型或 MoE 架构的唯一高效硬件底座。

下一代 AI 视频生成与多模态内容工厂

针对 Sora 级别、极度消耗显存容量与读写带宽的复杂多模态任务(如超长序列 DiT 架构模型),B200 整机提供了划时代的解放。单卡 8.0 TB/s 的带宽允许将极高分辨率(8K+)的视频渲染算子和超长上下文窗口完整驻留于显存池中,彻底打破 OOM 瓶颈。单台服务器即可作为极其强大的高并发多模态内容生成引擎,重塑 AIGC 商业出图与视频生成的生产力边界。

极致吞吐与极低成本的云端 API 推理底座

对于需要支撑全球规模用户并发请求的大语言模型(LLM)服务商,B200 整机展现出了碾压级的推理性价比。在处理超大模型的高并发 API 请求时,其推理性能相较于 H100 实现了多达 15 倍的跃升。采购 B200 整机集群,能够帮助云厂商与头部 AI 企业呈指数级拉低单次 Token 的生成成本(TCO),构建极具竞争力的 MLaaS 平台。

百 exaFLOPS 级超级计算机与数字孪生

为全球顶级的国家实验室和前沿量化机构提供物理级精准的计算环境。B200 整机底层的双精度(FP64)与极致张量运算能力同样迎来飞跃,在气候模拟、创新药研发、高能物理仿真等极其依赖海量数据吞吐的科学领域,提供人类当前所能触及的算力巅峰。