极高性价比的大模型高并发推理服务

H20 PCIE 虽然在峰值算力上有所限制,但完整保留了 96GB HBM3 显存和高达 4.0 TB/s 的恐怖显存带宽。由于大语言模型(LLM)的推理过程(特别是长文本生成)极度依赖显存带宽而非纯算力,H20 PCIE 在承载海量用户并发的推理任务时,展现出了碾压传统显卡的性价比,是构建企业级 AI API 接口和云端推理底座的首选硬件。

企业私有化大模型本地微调与数据隔离

对于金融、政务、医疗等对数据安全有严苛要求的行业,通过采购 H20 PCIE 显卡并在本地机房部署标准机架式服务器,可以安全、高效地完成百亿至千亿参数开源大模型(如 Qwen、Llama 系列)的 LoRA 或全量微调。既保证了核心业务数据绝对不出域,又获得了 Hopper 架构带来的高效计算红利。

平滑升级与标准化智算中心算力扩容

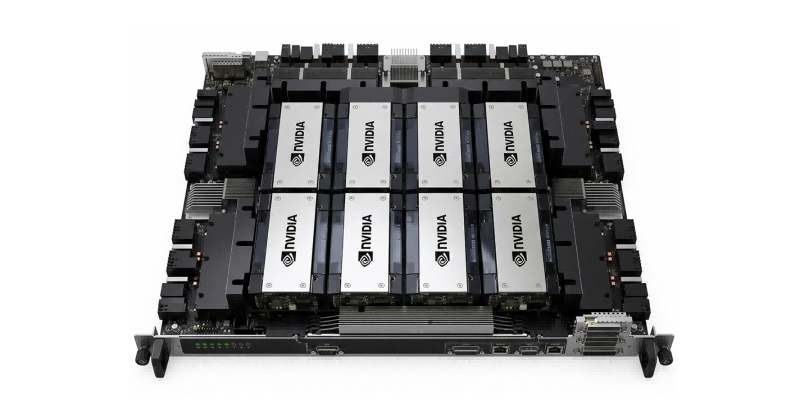

相比于对机房供电、散热和机柜定制有极高要求的 SXM/HGX 模组,PCIE 版本的 H20 具有无与伦比的通用性。它能够轻松插拔部署于各大主流品牌(如浪潮、新华三、超聚变等)的标准 2U/4U 服务器中。非常适合传统数据中心在不进行大规模基础设施改造的前提下,快速、低成本地转型为提供 AI 算力的智算中心。

高显存需求的多模态生成与复杂 AI 节点

在运行复杂的 ComfyUI 图像工作流、部署大参数视觉模型(Vision Models)或最新的开源 AI 视频生成架构时,96GB 的大显存让开发者彻底告别显存溢出(OOM)的困扰,能够在一个节点内处理更长序列、更高分辨率的多模态生成任务。