大模型高并发推理与商业化云服务部署

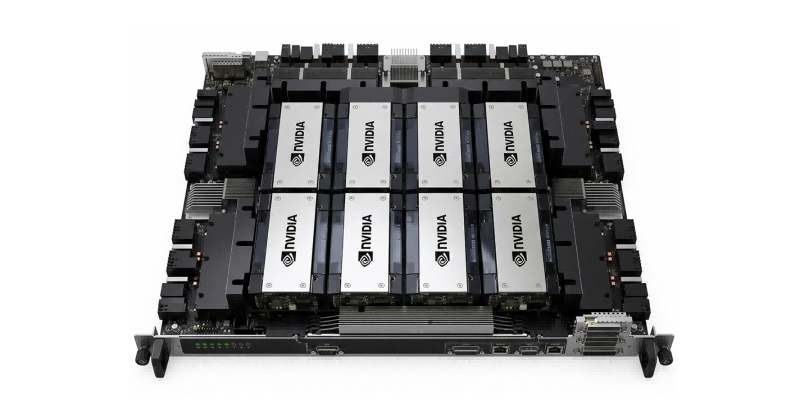

凭借单卡 96GB HBM3 显存和高达 4.0 TB/s 的极致显存带宽,H20 整机服务器是目前大语言模型(LLM)推理任务中性价比最高的底座。由于大模型推理性能往往受限于显存带宽而非计算算力,8 卡 H20 集群能够以极高的吞吐量处理海量用户的并发请求。它是构建企业级 AI 聊天机器人、多轮对话系统及 MLaaS 平台的理想选择,能显著降低单次 Token 生成的运营成本。

企业级私有化模型微调与数据安全隔离

针对金融、政务及大型国央企对于数据不出域的硬性要求,8 卡 H20 整机提供了高达 768GB 的海量总显存,结合 900 GB/s 的 NVLink 高速互联。这使得企业可以在本地机房轻松完成千亿参数规模大模型(如 Qwen-72B、Llama-3-70B)的 LoRA 或全量参数微调,在保证核心业务逻辑与私有知识库绝对安全的前提下,快速迭代自有行业大模型。

合规的大规模智算集群与算力底座建设

作为专为特定市场出口合规要求量身定制的高端产品,H20 确保了智算中心在算力供应链上的长期稳定与合规安全。支持通过无损网络(如 400G InfiniBand 或 RoCE)构建千卡甚至万卡规模的超大算力集群。凭借成熟的 Hopper 架构软件生态,能够无缝兼容主流深度学习框架,是大型企业和科研机构建设合规算力底座的“压舱石”。

多模态生成与复杂 AI 视频流处理

在运行基于 DiT 架构的视频生成模型或处理超长序列的多模态任务时,H20 的高带宽显存优势依然显著。8 卡整机能够支撑复杂节点工作流的高效并行,在图像超分、长视频渲染等场景中表现稳定,能够有效避免因显存容量或带宽不足导致的计算瓶颈。