一、市场概览:规模扩张与结构分化

1.1 市场规模持续高速增长

根据Gartner的测算,2026年全球AI基础设施市场规模将达到约2.5万亿美元,其中“AI基础设施”细分市场预计为1.36万亿美元,较2025年的9640亿美元增长显著。Research and Markets的数据显示,数据中心GPU市场将从2025年的261亿美元增长至2026年的347亿美元,年复合增长率达32.9%,预计到2030年将突破1065亿美元。

1.2 市场驱动力分析

本轮GPU算力市场的爆发式增长主要源于三大结构性因素:

-

企业AI从概念验证走向规模化生产:超过60%的财富500强企业已在云端GPU基础设施上运行至少一个生产级AI工作负载,这些系统服务于客户交互、推荐引擎、欺诈检测等收入核心业务。

-

云服务普及推动算力需求:2023年欧盟企业云计算使用率达42.5%,云服务商通过GPU加速实现AI、机器学习、实时图形处理的高效运行。

-

CSP资本开支维持高位:2026年北美五大CSP(亚马逊、微软、Meta、谷歌、甲骨文)资本开支合计预计达7295亿美元,同比增速超60%,较2023年增长3.5倍,绝大部分投向AI算力基础设施。

二、核心趋势之一:推理拐点到来,算力需求结构重塑

2.1 推理取代训练成为增长主引擎

2026年GTC大会上,英伟达CEO黄仁勋明确宣告“推理拐点已经到来”。这一判断背后是AI产业从“模型训练时代”加速迈入“模型推理时代”的深刻转变。

关键数据支撑:

- IDC预测,到2027年推理算力在智能算力大盘中的占比将超过70%,成为算力需求的核心增长引擎

- 多家机构预测,到2026年第四季度,推理支出将以2:1的比例超过训练支出

- OpenAI推理API调用量在过去6个月增长近5倍,Meta明确2026年是“推理基础设施投资超过训练投资”的转折年

2.2 OpenClaw引爆智能体算力需求

OpenClaw作为开源智能体操作系统的爆火,成为驱动推理算力需求指数级增长的关键催化剂。这一技术突破推动AI从生成内容走向自主执行,直接带动Token消耗量的量级跃迁。

GMI Cloud创始人Alex Yeh的观察印证了这一趋势:“Token的推理使用量一直在暴增,而且是以倍数的方式在增长。我们的客户也从大型的训练客户转到很多推理需要的边缘端的节点。”他进一步指出,“全球算力需求才刚刚开始,甚至连1%或5%都还没有到。”

三、核心趋势之二:算力架构走向专用化与异构协同

3.1 从“通用GPU”到“专用分工”

2026年GTC释放的最强信号是:单一GPU主导AI计算的逻辑正在被打破。英伟达推出的Vera Rubin平台与Groq LPX推理机架,清晰勾勒出算力架构的演进方向——通用GPU与专用加速器的异构协同。

架构演进对比:

| 维度 | 传统架构 | 2026年新架构 |

|---|---|---|

| 核心理念 | 单芯片主导 | 机架级系统集成 |

| 计算单元 | GPU包揽一切 | GPU+CPU+LPU异构协同 |

| 优化目标 | 峰值算力(FLOPS) | 每瓦Token产出效率 |

| 推理分工 | GPU全流程 | Prefill/Decode/Orchestration分层 |

3.2 LPU登场:推理加速器的战略意义

英伟达收购Groq团队并推出LPU(Language Processing Unit),标志着其对推理场景的战略布局。LPU凭借片上SRAM架构实现极低延迟的Token生成,与GPU形成明确分工:

- GPU:处理预填充(Prefill)、注意力机制与大规模参数训练

- LPU:专攻解码(Decode)环节,加速低延迟推理场景

产业专家姚金鑫指出:“在Transformer推理中,Prefill、Decode、Orchestration三个阶段开始由不同硬件承担,LPX的出现本质上是对Decode阶段的一次专门优化。”

四、核心趋势之三:互联技术与能效革命

4.1 算网融合突破带宽瓶颈

随着大模型参数迈向万亿级,通信延迟与带宽瓶颈成为制约算力释放的核心障碍。IDC调研数据显示,当前AI大模型训练中数据通信耗时占比已达30%-40%。

2026年的技术突破体现在:

- NVLink 6与NVLink 72:实现72个GPU的全互联拓扑,单机柜带宽达260TB/s

- CPO光电共封装技术:Spectrum-6交换机将光引擎直接集成于交换芯片封装体,减少信号损耗,压缩端到端延迟

- 光铜混合互联:Rubin Ultra 576架构采用光、铜混合连接方式,光互连从机柜外延展至机柜内

4.2 液冷成为高密算力标配

Vera Rubin系统的100%液冷设计标志着冷却技术的临界点到来。随着训练服务器单机柜功率即将突破100kW,液冷从可选升级为必选配置。

市场预测:IDC预计到2029年,仅中国液冷服务器市场规模就将突破200亿美元,年复合增长率超50%,其中AI算力场景占比将超过60%。

能效评估维度也在发生转变——每瓦Token产出效率正取代传统FLOPS指标,成为考核智算算力的核心维度。

五、核心趋势之四:供给模式重构

5.1 算力供给的多元化格局

2026年,GPU算力供给已从“单一云厂商垄断”演变为“多层级生态”:

| 供给类型 | 代表厂商 | 核心优势 |

|---|---|---|

| 超大规模云 | AWS、Azure、GCP | 生态完整、全球覆盖 |

| 专业智算云(NeoCloud) | CoreWeave、Lambda | 性能密度高、成本优化 |

| 去中心化网络 | io.net | 成本低廉(降低70%)、弹性强 |

5.2 算力租赁市场持续升温

2026年算力供需失衡推动租赁价格大幅上涨,截至2月底,H200月租金环比上涨25%-30%,海内外云服务商开启涨价潮。

英伟达的战略布局进一步强化了这一趋势:投资CoreWeave、Nebius各20亿美元,支持其合计部署超10GW算力,以“投资换产能”的方式锁定市场供给。

5.3 企业算力采购模式进化

企业GPU采购正从“预留实例”转向“混合租赁模型”:

- 基线:预留容量用于核心模型维护

- 突发:去中心化网络应对推理峰值与批处理

-

现货:利用闲置超大规模算力进行机会性训练

六、市场格局与竞争态势

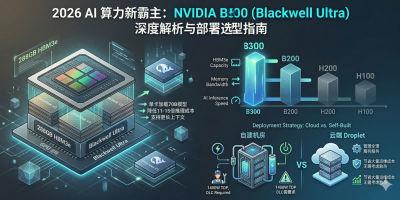

6.1 英伟达的生态护城河

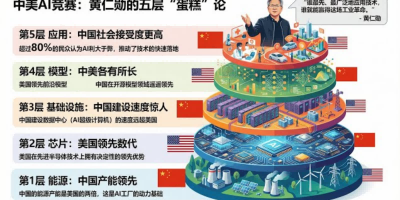

英伟达构建的“AI五层蛋糕”生态体系(能源层、芯片层、基建层、模型层、应用层)正在形成垂直整合的产业链控制力。黄仁勋在GTC上强调:“每一个企业都需要一套智能体系统,一套OpenClaw策略。”

核心战略转变:

- 叙事重心从“更强的GPU”转向“如何组织算力”

- 衡量标准从单卡性能转向Token产出效率

- 收入模式从卖芯片转向卖“AI工厂”解决方案

6.2 竞争格局变化

尽管英伟达仍占据主导地位,但竞争格局正在演变:

- 超大规模自研芯片:亚马逊Trainium、谷歌TPU、微软Maia 200逐步分流推理负载

- ASIC路线挑战:头部大厂推理需求持续走向自研ASIC路线,追求能效与成本自主可控

- 供应链联盟策略:英伟达通过绑定台积电、美光、三星、SK海力士等供应商,以联盟策略锁定先进封装与存储资源

七、展望与建议

7.1 2026-2027年关键预测

- 推理主导地位确立:推理算力占比超70%,推理支出以2:1超越训练支出

- Token成本持续下降:硬件效率提升与去中心化竞争推动大模型推理成本下降60%-75%

- 边缘算力加速渗透:边缘算力需求增速超过核心算力,智能体部署推动算力向工业现场、车端延伸

- 区域化格局形成:数据主权要求推动算力市场向区域化集群演变

7.2 对产业参与者的建议

对科技企业:

- 聚焦专用算力架构、算网融合、液冷能效等核心技术领域

- 评估异构计算方案(GPU+LPU)对推理业务的成本优化空间

对开发者:

- 依托OpenClaw等开源平台,聚焦垂直场景的智能体开发

- 关注Token经济学的演进,优化应用层面的算力消耗

对投资者:

- 重点关注液冷服务器、专用加速器、边缘算力等赛道

- 警惕技术迭代风险:中小厂商面临研发投入与供应链整合的双重压力